Tekoäly ottaa nyt valtavia harppauksia eri soveltamisaloilla. Tekstiä laajasti tuottavat ChatGPT, Bard ja muut sekä kuvia luovat DALL-E ja Stable Diffusion kilpailijoidensa kanssa ovat levinneet räjähdysmäisesti ja ravisuttaneet maailmaa.

Facebookin ja Instagramin emoyhtiö Metan tekoälylaboratorio julkaisi nyt konenäköpuolelle yleiskäyttöiseksi tekoälymalliksi tarkoitetun Segment Anything Model (SAM) -tekoälymallin sekä siihen liittyvän Segment Anything 1-Billion (SA-1B) -datasetin tutkijoiden käyttöön. Tavoitteena on antaa tutkijoille työkaluja entistä parempien konenäkösovelluksien käyttöön.

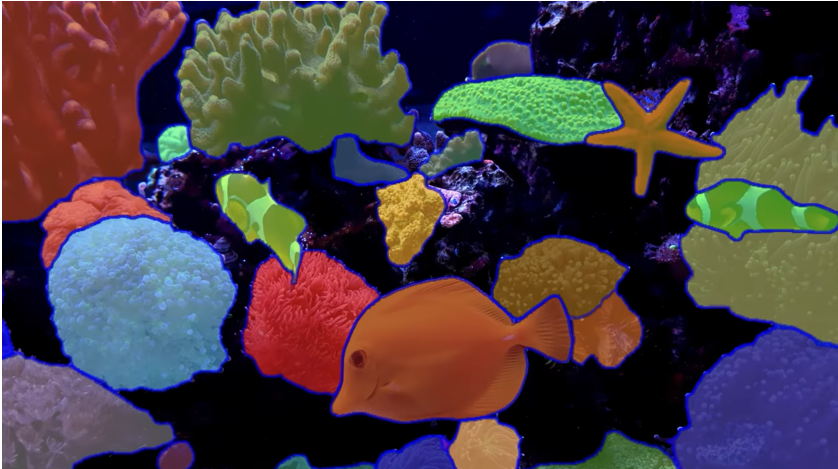

SAM on tarkoitettu kuvien segmentointiin. Segmentointi on konenäön ydinprosesseja. Se hyödyntää tekoälymalleja tunnistaakseen hahmoja tutkittavasta kuvasta. Käyttökohteet vaihtelevat tieteellisestä kuvantamisesta kuvankäsittelyyn.

Toimivan tekoälymallin kehittäminen tarkoin määriteltyihin käyttötapauksiin on kuitenkin ollut erittäin vaikeaa. Mitä monimutkaisempi tai tarkempi käyttötapaus, sitä enemmän tekoäly pitää opettaa toimimaan juuri siinä ympäristössä.

Tekoälymallien kehittämisessä pitää tuntea käyttötapaus todella tarkasti sekä tutkijoilla pitää olla käytössä juuri siihen tapaukseen tarkoitettua dataa.

Meta lupaa, että SAM ja SA-1B pystyvät päihittämään tämän ongelman. Segment Anything -projektin tarkoituksena on vähentää käyttötapauskohtaisen osaamisen, opettamisen ja räätälöidyn datan tarvetta kuvien segmentoinnissa.

Metan tutkijoiden mukaan SAM on tarkoitettu pohjamalliksi kuvien segmentointiin. Sitä voi käyttää suoraan useissa erilaisissa käyttötapauksissa ilman lisäopettamista.

Voit tutustua Segment Anythingiin osoitteessa https://segment-anything.com/